Az AI projektek során bekövetkező adatvédelmi incidens nem csupán pénzügyi veszteséget okoz, hanem az ügyfelek bizalmát és a vállalat hírnevét is rombolja. Az adatbiztonság az AI teljes életciklusa során kritikus tényező, az adatgyűjtéstől egészen a modell üzemeltetéséig. Középvállalatoknál különösen éles ez a kérdés: a rendelkezésre álló erőforrások korlátozottak, miközben a szabályozói elvárások és a kiberfenyegetések folyamatosan nőnek. Ez az útmutató konkrét lépéseket, elkerülhető hibákat és bevált módszereket mutat be, amelyekkel biztonságos alapokra helyezheti AI projektjét.

Tartalomjegyzék

- AI projektek adatbiztonsági kihívásai

- Szükséges feltételek és eszközök AI adatbiztonságához

- Lépésről lépésre: az AI projekt adatbiztonsági folyamatának megvalósítása

- Leggyakoribb hibák és azok elkerülése

- Hitelesítés, monitoring és folyamatos javítás

- AI projektek adatbiztonságának megerősítése céges támogatással

- Gyakran ismételt kérdések

Fő Tanulságok

| Pont | Részletek |

|---|---|

| Adatbiztonság minden fázisban | Azonnal szükséges végiggondolni az adatvédelmet a teljes AI projekt során. |

| Átfogó megfelelés | A GDPR és az AI-hoz kapcsolt sztenderdek betartása kritikus a középvállalatoknak. |

| Folyamatos monitoring | Rendszeres ellenőrzés és audit elengedhetetlen az adatbiztonság fenntartásához. |

| OWASP keretrendszerek használata | Az OWASP útmutatók segítenek a főbb veszélyek csökkentésében az AI projektek során. |

AI projektek adatbiztonsági kihívásai

Az AI projekt életciklusa több kritikus szakaszból áll, és mindegyikben más jellegű biztonsági kockázatok merülnek fel. Az adatgyűjtés fázisában a nem megfelelően szűrt, érzékeny személyes adatok kerülhetnek a tanítóadatbázisba. A modell tanítása során az úgynevezett adatmérgezés (data poisoning) veszélye áll fenn, amikor egy támadó szándékosan torzítja a betanítási adatokat. A bevezetés és az üzemeltetés fázisában pedig a prompt injection és az érzékeny adatok kiszivárgása jelent komoly fenyegetést.

Az OWASP LLM Top 10 kockázati lista pontosan ezeket a veszélyeket azonosítja: prompt injection, insecure output handling, training data poisoning, érzékeny adatok kiszivárgása és az ellátási lánc sérülékenységei mind szerepelnek rajta. Ezek nem elméleti fenyegetések, hanem valós, dokumentált incidensek alapján összeállított lista. Az AI adatbiztonsági legjobb gyakorlatok alkalmazása ezért nem opcionális, hanem alapkövetelmény.

A középvállalatok számára különösen veszélyes a shadow AI jelensége: amikor az alkalmazottak a vállalat tudta nélkül használnak AI eszközöket, és céges adatokat töltenek fel külső platformokra. A NAIH AI felügyeleti projektje kifejezetten fókuszál az AI algoritmusok adatvédelmi megfelelőségére és a GDPR kompatibilitás ellenőrzésére, ami jelzi, hogy a hatóságok is komolyan veszik ezt a területet.

Főbb kockázati területek összefoglalva:

- Adatgyűjtés: személyes adatok nem megfelelő kezelése, hozzájárulás hiánya

- Modell tanítás: data poisoning, nem auditált tanítóadatok

- Bevezetés: prompt injection, jogosultságkezelési hibák

- Monitoring: model drift felismerésének hiánya, naplózás elmaradása

- Ellátási lánc: harmadik féltől származó komponensek sérülékenységei

A kockázatok AI rendszerekben kezelése nem egyszeri feladat, hanem folyamatos odafigyelést igényel. Az AI innovációs trendek követése segít abban, hogy mindig naprakész maradjon a fenyegetési környezettel kapcsolatban.

Szükséges feltételek és eszközök AI adatbiztonságához

Egy biztonságos AI projekt nem indul el megfelelő technikai és jogi alapok nélkül. A műszaki oldalon három pillér elengedhetetlen: titkosítás, hozzáférés-szabályozás és audit trail. A titkosítás mind az adatok tárolása, mind az átvitel során kötelező. A hozzáférés-szabályozás azt jelenti, hogy csak az kaphat hozzáférést az adatokhoz, akinek valóban szüksége van rá, és ezt rendszeresen felül kell vizsgálni.

A GDPR és az EU AI Act integrációja magyar kontextusban kritikus követelmény. Az EU AI Act 2026-tól fokozatosan lép életbe, és a magas kockázatú AI rendszerekre szigorú átláthatósági és dokumentációs kötelezettségeket ír elő. A GDPR megfelelés lépései jól strukturált keretet adnak az adatkezelési folyamatok rendbe tételéhez.

A legfontosabb eszközök és megoldások:

| Eszközkategória | Funkció | Példa megoldás |

|---|---|---|

| IAM (Identity and Access Management) | Hozzáférés-szabályozás, szerepkörök kezelése | Azure AD, Okta |

| DLP (Data Loss Prevention) | Érzékeny adatok kiszivárgásának megakadályozása | Microsoft Purview |

| SIEM | Biztonsági események naplózása és elemzése | Splunk, Microsoft Sentinel |

| Titkosítási megoldások | Adatok védelme tároláskor és átvitelkor | HashiCorp Vault |

| Monitoring eszközök | Modell viselkedésének és adatfolyamoknak a figyelése | MLflow, Evidently AI |

Egy vállalati AI szabályzat elkészítése szintén alapkövetelmény. Ez rögzíti, hogy ki, mikor és milyen adatokhoz férhet hozzá, milyen AI eszközök használata engedélyezett, és mi a teendő incidens esetén. Az AI projekt tervezési folyamata során érdemes ezeket a szabályzatokat már a legelején beépíteni a projektstruktúrába.

Profi tipp: Ne várja meg, amíg a jogszabályi megfelelés kérdése felmerül egy audit során. Készítsen adatkezelési térképet (data map) már a projekt tervezési fázisában, amely dokumentálja, hogy milyen adatok kerülnek be a rendszerbe, hol tárolódnak, és ki fér hozzájuk.

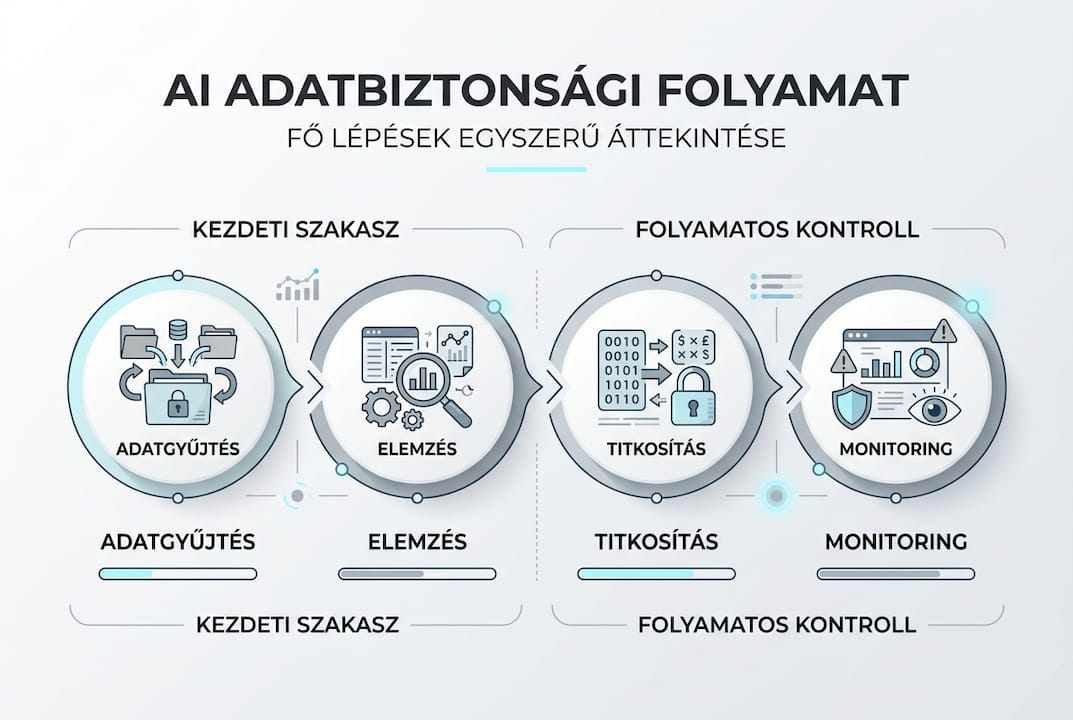

Lépésről lépésre: az AI projekt adatbiztonsági folyamatának megvalósítása

Az adatbiztonság nem egy egyszeri beállítás, hanem a teljes fejlesztési és üzemeltetési folyamatba integrált szemlélet. Az AWS Gen AI adatstratégiai ajánlása szerint a zéró bizalom elvű hozzáférés-kezelés, az adatok titkosítása és a RAG pipeline védelme alapkövetelmény minden generatív AI projektnél.

-

Adatgyűjtés és adatminimalizálás: Csak azokat az adatokat gyűjtse, amelyek valóban szükségesek a modell céljához. A data minimisation elvek alkalmazása csökkenti a kockázatot és egyszerűsíti a GDPR megfelelést.

-

Adatfeldolgozás és anonimizálás: Az érzékeny személyes adatokat anonimizálja vagy pszeudoanonimizálja a tanítás előtt. Dokumentálja az összes adattranszformációs lépést, hogy visszakövethetők legyenek.

-

Modell tanítása: Ellenőrizze a tanítóadatok forrását és integritását. Vezessen be adatvalidációs lépéseket, amelyek kiszűrik a szennyezett vagy manipulált adatokat. Rögzítse, melyik adatkészlettel, mikor és milyen paraméterekkel tanította a modellt.

-

Bevezetés és hozzáférés-kezelés: Alkalmazza a legkisebb jogosultság elvét (least privilege). Minden felhasználónak és rendszerkomponensnek csak annyi hozzáférése legyen, amennyire feltétlenül szüksége van. Vezessen be API gateway-t a modell végpontjainak védelmére.

-

Folyamatos monitoring: Figyelje a modell kimeneteit anomáliák szempontjából. Naplózzon minden hozzáférési eseményt és adatfolyamot. Állítson be riasztásokat szokatlan viselkedés esetére.

Az AI workflow cégeknek kialakítása során érdemes ezeket a biztonsági ellenőrzési pontokat beépíteni a fejlesztési pipeline-ba. Az AI tudásmenedzsment szempontjából is kritikus, hogy a vállalati adatok kezelése dokumentált és auditálható legyen.

Profi tipp: Végezzen rendszeres red team gyakorlatokat, ahol a csapat szándékosan próbálja megtámadni a saját AI rendszerét. Ez a módszer sokkal hatékonyabban tárja fel a gyenge pontokat, mint a passzív megfigyelés.

| Fázis | Fő biztonsági kontroll | Leggyakoribb hiba |

|---|---|---|

| Adatgyűjtés | Adatminimalizálás, hozzájárulás kezelése | Felesleges személyes adatok gyűjtése |

| Tanítás | Adatvalidáció, verziókövetés | Nem auditált tanítóadatok |

| Bevezetés | Least privilege, API védelem | Túl széles hozzáférési jogok |

| Monitoring | Anomáliadetekció, naplózás | Naplók hiánya vagy nem olvasása |

Leggyakoribb hibák és azok elkerülése

A középvállalatok AI projektjeiben visszatérő mintázatok figyelhetők meg a biztonsági hibák terén. A shadow AI a cégek 70-90%-ánál megjelenik, ami azt jelenti, hogy az alkalmazottak nagy valószínűséggel már most is használnak nem jóváhagyott AI eszközöket. Ez nem rosszindulat, hanem a hatékonyság iránti igény, de komoly adatvédelmi kockázatot jelent.

A leggyakoribb hibák listája:

- Shadow AI kezelésének hiánya: Nincs szabályzat arra, milyen AI eszközök használhatók, így az alkalmazottak céges adatokat töltenek fel külső platformokra.

- Helytelen jogosultságkezelés: Túl sok felhasználónak van hozzáférése érzékeny adatokhoz, és a jogosultságokat nem vizsgálják felül rendszeresen.

- Dokumentálatlan folyamatok: Nincs rögzítve, ki, mikor és milyen adatokhoz fért hozzá, ami incidens esetén lehetetlenné teszi a kivizsgálást.

- Szigetszerű adathasználat: Különböző részlegek különböző adatforrásokat használnak, nincs egységes adatkezelési politika.

- Harmadik fél kockázatainak figyelmen kívül hagyása: Az IT biztonsági fenyegetések jelentős része a külső szállítókon és integrált SaaS megoldásokon keresztül érkezik.

„Az adatbiztonsági incidensek többsége nem kifinomult külső támadás eredménye, hanem belső folyamatok hiányosságaiból fakad: nem frissített jogosultságok, dokumentálatlan adatfolyamok, és nem kezelt shadow IT."

Az adatintegrációs workflow hibák elkerülése érdekében érdemes rendszeres belső auditokat tartani, ahol átvizsgálják az összes aktív adatfolyamot és hozzáférési jogosultságot. Az AI hibák esettanulmányai jól mutatják, hogy a legtöbb incidens megelőzhető lett volna alapvető biztonsági higiéniával.

Hitelesítés, monitoring és folyamatos javítás

Az adatbiztonsági intézkedések bevezetése után a munka nem ér véget. A folyamatos monitoring és a rendszeres felülvizsgálat az, ami hosszú távon fenntartja a biztonságot. Az AWS Gen AI ajánlása szerint a model drift, vagyis a modell viselkedésének időbeli eltolódása, az egyik leggyakrabban figyelmen kívül hagyott kockázat.

A folyamatos monitoring és hitelesítés lépései:

-

Naplózás és audit trail: Minden adathozzáférési eseményt, modell lekérdezést és rendszerváltozást naplózzon. A naplókat tárolja biztonságos, módosíthatatlan formában, és rendszeresen vizsgálja át őket.

-

Anomáliadetekció beállítása: Állítson be automatikus riasztásokat, amelyek jelzik, ha szokatlan mennyiségű adatot kérdeznek le, vagy ha ismeretlen forrásból érkezik hozzáférési kísérlet.

-

Rendszeres biztonsági felülvizsgálat: Legalább negyedévente végezzen teljes körű biztonsági auditot, amely kiterjed a hozzáférési jogosultságokra, a titkosítási kulcsok érvényességére és a szoftverkomponensek frissítettségére.

-

Model drift monitoring: Figyelje, hogy a modell kimenetei idővel nem változnak-e szisztematikusan. A drift jelezheti adatmérgezést vagy a tanítóadatok elavulását.

-

Incidenskezelési terv tesztelése: Évente legalább egyszer szimuláljon egy adatvédelmi incidenst, és ellenőrizze, hogy a csapat tudja-e, mit kell tennie.

A technológiai integráció lépései során érdemes ezeket a monitoring folyamatokat már az architektúra tervezésekor beépíteni, ne utólag hozzáadni. Az OWASP legjobb gyakorlatai részletes útmutatást adnak ahhoz, hogyan építsen fel egy robusztus, folyamatosan felügyelt AI biztonsági rendszert.

AI projektek adatbiztonságának megerősítése céges támogatással

Az önálló megvalósítás lehetséges, de a középvállalatok számára a fenntartható adatbiztonság általában szakértői partnert igényel. A szabályozói környezet gyorsan változik, az OWASP ajánlások frissülnek, és egy belső csapat nehezen tartja naprakészen magát minden területen egyszerre.

A Stratify.hu AI adatbiztonsági szolgáltatásai pontosan erre a résre kínálnak megoldást: a kezdeti kockázatfelméréstől a szabályzatok kidolgozásán át a folyamatos megfelelési monitoringig. A bevezetések módszertana strukturált, lépésről lépésre haladó folyamatot követ, amely biztosítja, hogy az adatbiztonsági szempontok ne utólag kerüljenek be a projektbe, hanem az alapoktól fogva részei legyenek. Ha AI projektet tervez vagy már futó rendszert szeretne auditálni, érdemes szakértői szemmel is átnézni a jelenlegi folyamatokat.

Gyakran ismételt kérdések

Miért fontos az adatbiztonság az AI projektekben?

Az AI rendszerek biztonságos adatkezelése csökkenti az üzleti kockázatokat és támogatja a jogszabályi megfelelést, miközben védi a vállalat hírnevét és az ügyfelek bizalmát.

Milyen adatbiztonsági standardokat érdemes alkalmazni magyar középvállalatok számára?

A GDPR és EU AI Act alapkövetelmény, amelyet az OWASP LLM Top 10 ajánlásaival és az ISO 27001 keretrendszerrel érdemes kiegészíteni a teljes körű védelem érdekében.

Mik a legfontosabb első lépések egy AI projekt adatbiztonságának megalapozásához?

A teljes lifecycle biztonság érdekében az első lépések: hozzáférés-szabályozás bevezetése, adatok titkosítása, vállalati AI szabályzat elkészítése és monitoring rendszer felállítása.

Milyen tipikus hibák vezetnek adatvédelmi incidenshez AI projekteknél?

A shadow AI magas aránya, a nem dokumentált folyamatok és a helytelen jogosultságkezelés a három leggyakoribb veszélyforrás, amelyek megelőzhetők rendszeres audittal és egyértelmű szabályzatokkal.