TL;DR:

- A hatékony AI governance alapja a rendszeres AI-eszközökhöz való pontos felmérés és auditálás.

- A szabályozásoknak való megfelelés hosszú távon üzleti sikert és versenyelőnyt eredményezhet.

- Egyszerű, adaptív governance kerülése helyett a folyamatos fejlesztés, tapasztalati tanulás és szakértői támogatás ajánlott.

A mesterséges intelligencia bevezetése 2026-ban már nem opció, hanem versenyképességi kérdés. Ugyanakkor a gyors AI-adoptáció komoly szabályozási és etikai kockázatokat is hoz magával: az EU AI Act kötelező betartása, az adatvédelmi megfelelés és a belső felelősségi rendszerek kiépítése mind azonnali intézkedéseket igényelnek. A magyar középvállalatok számára különösen éles a helyzet, hiszen a 2026 közepéig érvényes határidők már most cselekvést követelnek. Ez a cikk konkrét, prioritás szerinti tippeket ad ahhoz, hogy cége ne csak megfeleljen a szabályozásnak, hanem valódi üzleti előnyt is kovácsoljon a felelős AI irányításból.

Tartalomjegyzék

- Az AI rendszerek feltérképezése és auditálása

- Kockázatalapú besorolás: EU AI Act megfeleltetés gyakorlata

- Governance beépítése a vállalati folyamatokba

- Framework-ök: NIST vs. ISO 42001 kontra magyar ajánlások

- Hatékonyság, felelősség, profit: AI governance üzleti hatása

- Miért fontos a magyar középvállalatok számára a gyakorlatias, adaptív AI governance?

- Legyen az AI governance egyszerű és hatékony – szakértői támogatással

- Gyakran ismételt kérdések

Fő Tanulságok

| Pont | Részletek |

|---|---|

| AI audit elengedhetetlen | A teljes AI eszközkészlet, adatforrások és használók naprakész feltérképezése az első lépés minden governance stratégiában. |

| Kockázatok szerinti megfelelés | Az AI rendszereket az EU AI Act kockázati szintjei szerint kell besorolni és dokumentálni. |

| Integrálás a vállalati folyamatokba | A governance csak akkor működik, ha a mindennapi szabályzatok és ellenőrzések részévé válik. |

| Személyre szabott keretrendszerek | A NIST RMF és az ISO 42001 kínálta lehetőségek közül a működéshez legalkalmasabbat érdemes kombinálni. |

| Mérhető üzleti előnyök | A felelős AI governance igazoltan javítja a vállalati teljesítményt, ROI-t és ügyfélbizalmat. |

Az AI rendszerek feltérképezése és auditálása

A sikeres AI governance első lépése mindig a pontos helyzetkép. Nem lehet irányítani azt, amit nem látunk. Meglepő, de sok középvállalatnál a különböző osztályok önállóan vezettek be AI eszközöket, például chatbotokat, automatizált riportokat vagy prediktív modelleket, és ezekről a cégvezetésnek nincs teljes képe.

Az első és legfontosabb feladat az, hogy felmérje az AI-eszközöket, beleértve az adatforrásokat, a felhasználókat és az érintett döntéseket. Ez nem csupán adminisztratív kötelezettség. Egy ilyen leltár azonnal megmutatja, hol vannak kockázatok, hol hiányoznak kontrollok, és hol lehet optimalizálni a folyamatokat.

Miért kritikus az AI-leltár? Gondoljon bele: ha egy HR-osztály gépi tanulással szűri az önéletrajzokat, de erről a compliance csapat nem tud, akkor az EU AI Act szerinti magas kockázatú rendszer láthatatlanul működik a szervezetben. Ez nemcsak bírságot, hanem reputációs kárt is okozhat.

A rendszeres AI audit emellett segít azonosítani az elavult vagy nem megfelelően karbantartott modelleket. Egy AI rendszer, amelyet két évvel ezelőtt tanítottak be, ma már torz eredményeket adhat, ha az adatkörnyezet megváltozott. Az audit ezt is feltárja.

Lépésről lépésre: AI-készlet felmérése középvállalatként

- Gyűjtsön össze minden osztálytól listát a használt szoftverekről és AI-funkciókról, beleértve a harmadik féltől vásárolt megoldásokat is.

- Azonosítsa az egyes eszközök mögötti adatforrásokat: személyes adatokat kezelnek-e, és milyen döntéseket befolyásolnak?

- Rendelje hozzá az egyes eszközökhöz a felelős személyt vagy csapatot.

- Dokumentálja az eszközök kockázati szintjét egy egyszerű mátrixban (alacsony, közepes, magas).

- Tervezze be a rendszeres felülvizsgálatot, legalább félévente.

Az AI innovációkról szóló szakmai tartalmak böngészése közben is látható, hogy a legjobb eredményt azok a cégek érik el, amelyek ezt a lépést nem sietik el, hanem valóban alapos feltérképezéssel kezdik.

Profi tipp: Használjon automatizált eszközöket a folyamatos AI-felméréshez. Számos SaaS megoldás képes valós időben monitorozni, hogy a szervezetben milyen AI-alapú folyamatok futnak, és riasztást küld, ha új, nem regisztrált eszköz jelenik meg. Ez különösen hasznos, ha a vállalat több telephelyen működik.

Kockázatalapú besorolás: EU AI Act megfeleltetés gyakorlata

A készletfelmérés után ki kell választani a megfelelő kockázatkezelési módszert. Az EU AI Act négy kockázati szintet határoz meg, és a besorolás alapján eltérő megfelelési kötelezettségek vonatkoznak a rendszerekre, a 2026 közepi határidőig bezárólag.

| Kockázati szint | Példák | Megfelelési kötelezettség |

|---|---|---|

| Elfogadhatatlan | Szociális pontozás, tudatalatti manipuláció | Teljes tiltás |

| Magas kockázatú | HR szűrés, hitelminősítés, egészségügyi döntések | Megfelelőségi értékelés, dokumentáció |

| Korlátozott | Chatbotok, deepfake tartalom | Átláthatósági kötelezettség |

| Minimális | Spam szűrők, ajánlórendszerek | Nincs különleges kötelezettség |

A magyar középvállalatok számára a legfontosabb kérdés: melyik kategóriába esnek a saját rendszereik? A tapasztalatok szerint a cégek jelentős része nem tudja pontosan megítélni, hogy például egy automatizált ajánlatkészítő rendszer magas kockázatúnak minősül-e, ha az ügyfelek pénzügyi döntéseit befolyásolja.

Kiemelt megfelelési feladatok 2026 közepéig:

- Minden magas kockázatú AI rendszerhez megfelelőségi értékelés elkészítése

- Technikai dokumentáció és kockázatkezelési terv rögzítése

- Emberi felügyelet biztosítása az automatizált döntéseknél

- Incidenskezelési eljárás kidolgozása AI-specifikus esetekre

- Adatminőségi követelmények teljesítése a betanító adatokra vonatkozóan

Fontos adat: az iparági elemzések szerint a feldolgozóipari és pénzügyi szektorban működő középvállalatok közel 40 százaléka használ legalább egy olyan AI rendszert, amely magas kockázatú kategóriába eshet. Ez azt jelenti, hogy a megfelelési kötelezettség nem egy szűk cégkör problémája, hanem széleskörű felkészülést igényel.

Praktikus tanács: ne próbálja egyszerre az összes rendszert auditálni. Kezdje a legkockázatosabb és legkritikusabb folyamatokkal, és egy egyszerűsített önellenőrzési sablonnal mérje fel az állapotot. Ezt később bővítheti, ahogy a szervezet kapacitása és tapasztalata növekszik.

Governance beépítése a vállalati folyamatokba

A megfeleléshez valódi beágyazottság szükséges a mindennapi működésbe. Az AI governance nem lehet egyetlen dokumentum a szerveren, amelyet senki nem olvas. A governance beépítése a meglévő folyamatokba, például az adatvédelmi értékelésekbe, a szállítói felülvizsgálatokba és az éves tréningekbe, az egyetlen módja annak, hogy valódi kontroll épüljön ki.

Miért kell összhangban kezelni a governance-t az adatvédelemmel? Az AI rendszerek szinte mindig személyes adatokat is kezelnek. Ha a GDPR szerinti adatvédelmi hatásvizsgálatot és az AI kockázatértékelést külön folyamatban végzik, akkor az átfedések és a hiányosságok szinte biztosan megjelennek. Az összehangolt megközelítés nemcsak hatékonyabb, hanem megbízhatóbb eredményt is ad.

Konkrét példák a beágyazott governance-re:

- Privacy assessment kiterjesztése: Minden új AI projekt indításakor automatikusan végezzenek adatvédelmi és AI kockázatértékelést együtt, ugyanazon sablon alapján.

- Szállítói felülvizsgálat: Minden külső AI megoldás beszerzésekor kérjenek átláthatósági dokumentációt és biztonsági tanúsítványt a szállítótól.

- Éves tréning: Minden érintett munkavállaló kapjon legalább félnapos képzést az AI felelős használatáról és a belső szabályokról.

- Incidensjelentés: Legyen egyértelmű eljárás arra, ha egy AI rendszer hibás vagy diszkriminatív döntést hoz.

„A felelős AI governance nem adminisztratív teher, hanem stratégiai befektetés. Azok a szervezetek, amelyek ezt komolyan veszik, hosszú távon versenyelőnyre tesznek szert az ügyféllbizalom és a működési hatékonyság terén egyaránt."

Az AI governance és kontroll kérdéseivel foglalkozó részletes útmutatók is megerősítik, hogy a formális megfelelés önmagában nem elegendő. A valódi érték ott keletkezik, ahol a governance beépül a döntéshozatali kultúrába.

Profi tipp: Használjon szintenként eltérő governance sablonokat. Egy alacsony kockázatú chatbot esetén elegendő egy egyoldalas ellenőrzőlista, míg egy magas kockázatú HR-szűrő rendszerhez részletes kockázatkezelési terv és negyedéves felülvizsgálat szükséges. A sablonok testreszabása időt takarít meg és csökkenti a hibák esélyét. Az AI szerepe a design és kommunikáció területén is jól mutatja, hogy a különböző alkalmazási területek eltérő kockázati profilokat hordoznak.

Framework-ök: NIST vs. ISO 42001 kontra magyar ajánlások

A működtetéshez keretrendszert kell választani. Melyik illik jobban a hazai piacra? Ez az egyik leggyakoribb kérdés, amellyel a magyar középvállalatok szembesülnek az AI governance bevezetésekor.

| Szempont | NIST AI RMF | ISO 42001 |

|---|---|---|

| Bevezetési idő | Gyors, rugalmas | Hosszabb, strukturáltabb |

| Certifikálhatóság | Nem certifikálható | Formális tanúsítvány szerezhető |

| Költség | Alacsonyabb | Magasabb |

| Rugalmasság | Magas | Közepes |

| Magyar piaci elfogadottság | Növekvő | Egyre elterjedtebb |

A NIST AI Risk Management Framework egyik legnagyobb előnye, hogy nem előíró jellegű. Nem mondja meg, pontosan mit kell tenni, hanem egy rugalmas struktúrát ad, amelyet a vállalat saját kontextusához igazíthat. Ez különösen értékes olyan középvállalatok számára, amelyek gyorsan akarnak haladni, és nem engedhetik meg maguknak a hosszadalmas certifikációs folyamatot.

Az ISO 42001 ezzel szemben formális tanúsítást tesz lehetővé, ami egyre több közbeszerzési és nagyvállalati partnerkapcsolatban elvárás. Ha a cég tervezi, hogy külföldi piacokra lép vagy nagyobb megrendelőkkel dolgozik, az ISO 42001 certifikáció komoly versenyelőnyt jelent.

A Magyar Nemzeti AI Stratégia és az etikai kódex szintén fontos referenciapont. A hazai ajánlások sok esetben az EU irányelveket tükrözik, de figyelembe veszik a kis és közepes vállalatok sajátos helyzetét is. Érdemes ezeket a dokumentumokat is beépíteni a belső governance keretrendszerbe.

Fontos megjegyezni, hogy a felelős AI dimenziói között kompromisszumok léteznek: ha például a biztonságot maximalizáljuk, az adott esetben a méltányosságot vagy az adatvédelmet érintheti. A NIST keretrendszer segít ezeket a trade-offokat tudatosan kezelni és dokumentálni.

Ajánlott megközelítés magyar középvállalatoknak:

- Induljon a NIST RMF alapján, mert gyorsan bevezethető és azonnal értéket teremt.

- Párhuzamosan dokumentáljon az ISO 42001 követelményeivel összhangban, hogy a certifikáció később ne igényeljen újrakezdést.

- Kövesse nyomon az AI etika és vállalati felelősség területén megjelenő hazai és uniós iránymutatásokat.

Hatékonyság, felelősség, profit: AI governance üzleti hatása

Láthattuk a szabályokat. Most nézzük a valódi üzleti haszon oldalát. A felelős AI governance nem csupán compliance kérdés, hanem mérhető üzleti eredményeket hoz.

Egy 342 vállalatra kiterjedő empirikus kutatás igazolta, hogy a felelős AI governance szignifikánsan javítja a vállalati teljesítményt, beleértve a Tobin-féle Q mutatót, amely a piaci értéket és az eszközök könyv szerinti értékét hasonlítja össze. Ez azt jelenti, hogy a befektetők és a piac is értékeli a felelős AI irányítást.

| Üzleti mutató | Governance nélkül | Erős governance mellett |

|---|---|---|

| Ügyfélbizalom | Közepes | Magas |

| Megfelelési kockázat | Magas | Alacsony |

| Döntéshozatali sebesség | Lassabb (ad hoc) | Gyorsabb (strukturált) |

| Reputációs kockázat | Magas | Kontrollált |

| Hosszú távú ROI | Bizonytalan | Mérhető és pozitív |

Konkrét példák: egy logisztikai középvállalatnál a prediktív karbantartási AI bevezetése után az állásidő 23 százalékkal csökkent, de csak azért, mert a governance keretrendszer biztosította a modell folyamatos monitorozását és az adatminőség fenntartását. Governance nélkül a modell hat hónap után elavult volna, és téves döntéseket hozott volna.

Az adatalapú döntéshozatal és ROI területén szerzett tapasztalatok is megerősítik, hogy a legjobb megtérülést azok a projektek hozzák, ahol a governance és a fejlesztés párhuzamosan halad.

„Az AI governance nem lassítja a digitális transzformációt. Éppen ellenkezőleg: az a szervezet, amely megbízható, átlátható és felelős AI rendszereket működtet, gyorsabban nyer bizalmat, gyorsabban skálázódik, és kevesebb válságot kezel."

Miért fontos a magyar középvállalatok számára a gyakorlatias, adaptív AI governance?

Sok szervezet formálisan kezeli az AI irányítást: elkészül a dokumentum, megvan a pipa a listán, és mindenki visszatér a napi rutinhoz. Ez a megközelítés veszélyes. A formális megfelelés és a valódi kontroll között óriási a különbség, és ezt a különbséget általában egy incidens teszi láthatóvá, amikor már késő.

A magyar piacon sajátos kihívások is jelen vannak. A középvállalatok sokszor korlátozott IT-kapacitással dolgoznak, a compliance csapat hiányzik vagy más feladatokkal van túlterhelve, és a külső tanácsadók bevonása sem mindig opció. Ebben a helyzetben az adaptív, fokozatos megközelítés az egyetlen reális út.

Az adaptív governance lényege, hogy nem próbál tökéletes rendszert felépíteni az első naptól. Ehelyett egy működő, de egyszerű keretből indul, amelyet folyamatosan finomít a tapasztalatok alapján. Ez a megközelítés illeszkedik a magyar középvállalati valósághoz, és sokkal nagyobb eséllyel válik a kultúra részévé, mint egy kívülről erőltetett, komplex szabályrendszer.

Az üzleti értékteremtés és AI kapcsolatát vizsgálva is látható: azok a cégek boldogulnak, amelyek folyamatosan tanulnak, nem félnek módosítani a policy-t, és a governance-t nem egyszeri projektként, hanem folyamatos tevékenységként kezelik. Profi tipp: Ütemezzen be negyedévente rövid, 30 perces governance áttekintést a vezetői csapattal. Ez elegendő ahhoz, hogy a változásokat időben észrevegyék és kezeljék.

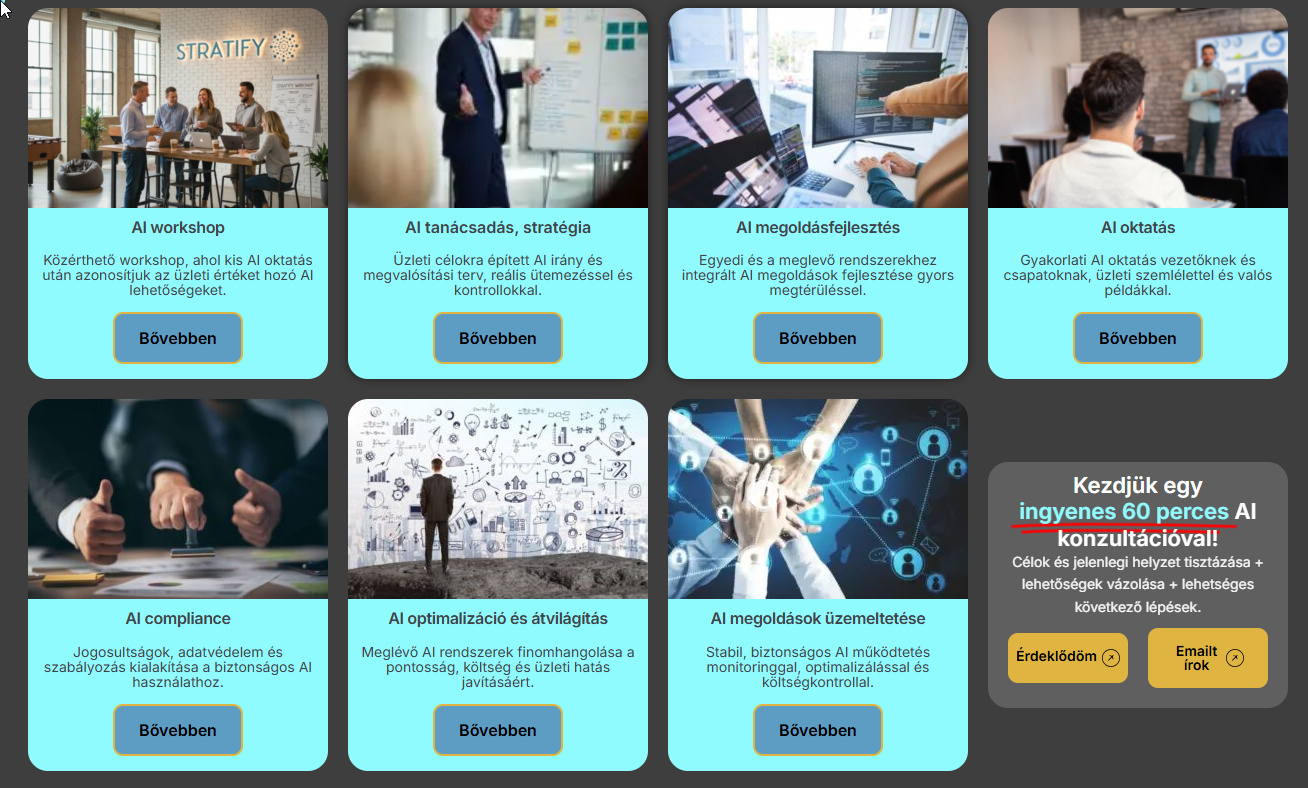

Legyen az AI governance egyszerű és hatékony – szakértői támogatással

Az AI governance felépítése komoly szaktudást igényel, és a legtöbb középvállalat számára a belső kapacitás önmagában nem elegendő. A Stratify szakértői csapata pontosan ebben nyújt segítséget: a teljes AI governance folyamat megtervezésétől az auditálásig és a megfelelési dokumentáció elkészítéséig.

Ha cége most kezdi el az AI governance kiépítését, vagy már meglévő rendszereit szeretné felülvizsgálni, az AI tanácsadás és audit szolgáltatások gyors és mérhető eredményeket hoznak. Az AI compliance megoldások kifejezetten a magyar szabályozási környezethez és a középvállalati igényekhez igazítva érhetők el. Vegye fel velünk a kapcsolatot, és kezdjük el közösen felépíteni azt a governance keretet, amely valódi üzleti értéket teremt.

Gyakran ismételt kérdések

Mi számít magas kockázatú AI rendszernek az EU AI Act alapján?

Azok az AI rendszerek minősülnek magas kockázatúnak, amelyek alapvető jogokat érintenek vagy kritikus döntéseket automatizálnak, például munkaerő-kiválasztás, hitelminősítés, egészségügyi diagnózis vagy jogosultság megállapítása területén. Ezekre részletes megfelelőségi értékelés és dokumentáció szükséges.

Milyen gyakran kell AI governance auditot tartani?

Az éves audit és policy felülvizsgálat minden érintett területen kötelező minimum, de gyorsan változó AI környezetben, például új modellek bevezetésekor, félévente is indokolt az áttekintés. A rendszeres ellenőrzés megelőzi a kockázatok felhalmozódását.

Javíthatja az AI governance a vállalat üzleti eredményeit?

Igen, empirikus kutatások igazolják, hogy a felelős AI governance szignifikánsan javítja a vállalati teljesítményt, növeli az ügyfélbizalmat és csökkenti a megfelelési kockázatokat, amelyek hosszú távon közvetlen pénzügyi előnnyé válnak.

Melyik AI governance framework-et érdemes választani elsőként?

Magyar középvállalatoknak a NIST RMF ajánlott gyors induláshoz, mivel rugalmas és gyorsan bevezethető. Az ISO 42001 akkor indokolt, ha formális certifikáció is szükséges, például külföldi partnerek vagy közbeszerzési elvárások miatt. A két keretrendszer kombinálható és egymásra épülő megközelítésben is alkalmazható.