TL;DR:

- Az AI adatvédelme összetettebb, mint a hagyományos rendszereké, folyamatos jogi és technikai figyelmet igényel.

- A modellben az adatok újra-azonosíthatósága veszélyezteti az anonimitást és növeli a jogi kockázatokat.

- A megfeleléshez részletes szerepkör-elemzés, dokumentálás és rendszeres felülvizsgálat szükséges az életciklus minden szakaszában.

Sokan hiszik azt, hogy ha egy AI-rendszer az adatokat feldolgozza, azok valahogy automatikusan „névtelenné" válnak, és a GDPR-megfelelés magától megoldódik. Ez tévedés, és egy olyan tévedés, amely milliós bírságokba, reputációs károkba és szabályozói vizsgálatokba kerülhet. Az AI adatvédelme nem egyszerűbb, mint a hagyományos rendszereké, hanem jóval összetettebb: a modell fejlesztésétől a napi üzemeltetésig minden szakaszban folyamatos jogi és technikai figyelmet igényel. Ez az útmutató összefoglalja a legfontosabb kockázatokat és a valódi megoldásokat, amelyeket egy magyar vállalati döntéshozónak ismernie kell.

Tartalomjegyzék

- Miért jelent az AI adatvédelem különös kihívást?

- Az adatkezelési szerepkörök tisztázása: ki a felelős?

- Életciklus-alapú megfelelőség: a tréningtől a bevezetésig

- Magyarországi DPO és DPIA fókusz: gyakorlati ajánlások

- Mi az, amit a szakértők gyakran rosszul láttatnak az AI adatvédelem terén?

- Lépjen a gyakorlati megfelelőség útjára AI tanácsadó partnertől

- Gyakran ismételt kérdések

Fő Tanulságok

| Pont | Részletek |

|---|---|

| Anonimitás nincs automatikusan | AI modellek adatkezelése eseti vizsgálatot és szigorú megfelelőséget igényel. |

| Szerepkörök tisztázása elengedhetetlen | A pontos adatkezelő/feldolgozó kijelölés az AI megfelelőség alapja. |

| Életciklus szemlélet szükséges | Az adatvédelmi megfelelőséget minden MI Projekt szakaszban dokumentálni kell. |

| NAIH ajánlásai gyakorlati támogatást adnak | A magyar ajánlások segítik a DPO-kat és cégeket a mindennapi megfelelésben. |

Miért jelent az AI adatvédelem különös kihívást?

Az AI-rendszerek adatkezelése alapvetően eltér a hagyományos szoftverekétől. Egy CRM-rendszer tárol adatokat, majd lekérdezi azokat. Egy mesterséges intelligencia modellje viszont ezeket az adatokat tanulásra is használja, ezáltal az összefüggések és minták beágyazódnak magába a modellbe. Ez az a pont, ahol az adatvédelmi kockázat gyökeresen máshogy jelenik meg.

„Nem minden AI-modell tekinthető automatikusan anonimnak; az anonimitás küszöbe magas, és eseti értékelést igényel." — EDPB Opinion 28/2024

Ez a megállapítás messzire ható következményekkel bír. Hiába töröl egy vállalat minden nevet és azonosítót a betanítási adatbázisból, a modell mégis képes lehet egyének azonosítására, ha az adathalmaz kellően specifikus. Ezt nevezzük újra-azonosíthatóságnak (re-identification), és a fejlett gépi tanulási módszerek éppen ezt teszik lehetővé. Az EDPB, vagyis az Európai Adatvédelmi Testület, az anonimitást nem technikai megoldásként, hanem jogi és statisztikai küszöbként határozza meg.

Az AI fejlesztésének különböző fázisaiban eltérő kockázati profilok jelennek meg:

- Adatgyűjtési fázis: Jogalap megléte, adatminőség és forrás hitelessége.

- Előfeldolgozási fázis: Anonimizálási módszerek értékelése, adatszegmentálás.

- Betanítási fázis: A modellbe „szivárgó" személyes minták és visszafejthetőség kockázata.

- Deployment fázis: Valós idejű döntéshozatal érintettsége, kimenet átláthatósága.

- Üzemeltetési fázis: Adatdrift, modellfrissítések és folyamatos megfelelőség-ellenőrzés.

Az AI governance tippek alkalmazása ezért nem egyszeri feladat, hanem a rendszer teljes életciklusán átívelő folyamat. Különösen fontos, hogy a magyarországi vállalatoknál az EU AI Act és a GDPR egyszerre érvényes, és ezek az elvárások összefonódnak. Ahol az egyik kihívást teremt, ott a másik is kérdéseket vet fel.

Az AI megfelelőségi kihívások 2026-ban még inkább fókuszba kerülnek, mert a felügyeleti hatóságok egyre inkább az AI-rendszerek auditálását és az átláthatóságot szorgalmazzák. Nem elegendő tehát a „legjobb szándék" dokumentálása, konkrét, igazolható intézkedéseket kell megvalósítani és dokumentálni.

Ami a jogi elvárásokat illeti: a tréningadat kiválasztásánál már meg kell jelölni a jogalapot, igazolni kell az adatforrás jogszerűségét, és mérlegelni kell az érintettek jogait. Ez nemcsak jogi megfelelés kérdése, hanem üzleti kockázatkezelés is: ha a modell jogellenes forrásból tanult, az az egész AI-projekt értékét kérdőjelezi meg.

Az adatkezelési szerepkörök tisztázása: ki a felelős?

Az AI-projektekben az adatkezelési szerepkörök meghatározása kritikus, mégis rendkívül gyakran marad homályban. A GDPR két alapfogalmat különböztet meg: az adatkezelő (controller) az, aki meghatározza az adatkezelés célját és eszközeit, míg az adatfeldolgozó (processor) az adatkezelő nevében végzi az adatkezelési műveleteket.

Az EDPS iránymutatása kiemeli a szerepkörök megfelelő kijelölésének fontosságát, különösen generatív AI-rendszereknél, ahol az AI-szolgáltató és a vállalat közötti viszony nem mindig egyértelmű.

A valóságban a szerepkörök meghatározása néha szinte magától értetődő, máskor viszont rendkívül összetett:

| Helyzet | Adatkezelő | Adatfeldolgozó |

|---|---|---|

| Vállalati CRM-adatok saját AI-modell betanítására | A vállalat | Nem releváns |

| SaaS AI-platform igénybevétele | A vállalat | Az AI-platform szolgáltatója |

| Közös fejlesztésű AI-modell két vállalat között | Mindkét vállalat (együttesen) | Esetlegesen harmadik fél |

| Harmadik fél által üzemeltetett AI-alapú HR-szoftver | A munkáltató vállalat | A szoftverfejlesztő cég |

Az életciklus során a szerepkörök is változhatnak. Például fejlesztési fázisban egy külső AI-fejlesztő partner adatfeldolgozóként tevékenykedik, de ha ugyanez a partner a modellt önállóan értékesíti más ügyfeleknek, ő maga válik adatkezelővé. Ez nem csupán elméleti probléma: ha a szerződés nem tükrözi helyesen a szerepköröket, a felelősség megoszlása jogi viták forrása lehet.

Hogyan tisztázzuk a szerepköröket egy AI-projektnél? Íme egy ajánlott folyamat:

- Azonosítsa az összes adatkezelési műveletet a projekt teljes életciklusára.

- Minden egyes műveletnél határozza meg, ki dönti el a cél és az eszköz kérdését.

- Ellenőrizze, hogy a meglévő szerződések (adatfeldolgozói megállapodások) lefedik-e az összes AI-specifikus adatáramlást.

- Dokumentálja az összes döntést írásban, és rendszeresen frissítse a nyilvántartást.

- Az AI szabályzat minta alapján készítsen belső politikát a szerepkörök kezelésére.

Profi tipp: Ne hagyja a szerepkör-meghatározást a jogi osztályra és az IT-osztályra külön-külön. A valóban hatékony megközelítés interdiszciplináris: jog, informatika, üzleti oldal és az adatvédelmi tisztviselő (DPO) együttes részvételét igényli már a projekt tervezési fázisában.

Ami a dokumentációt illeti, nem elegendő egyszer elvégezni a szerepkör-elemzést. Az AI-rendszer módosításakor, új funkcionalitás bevezetésekor, vagy akár ha a rendszer adatforrásai megváltoznak, a szerepköröket újra kell értékelni. Ez egy élő dokumentum, nem egy egyszeri jogászi feladat.

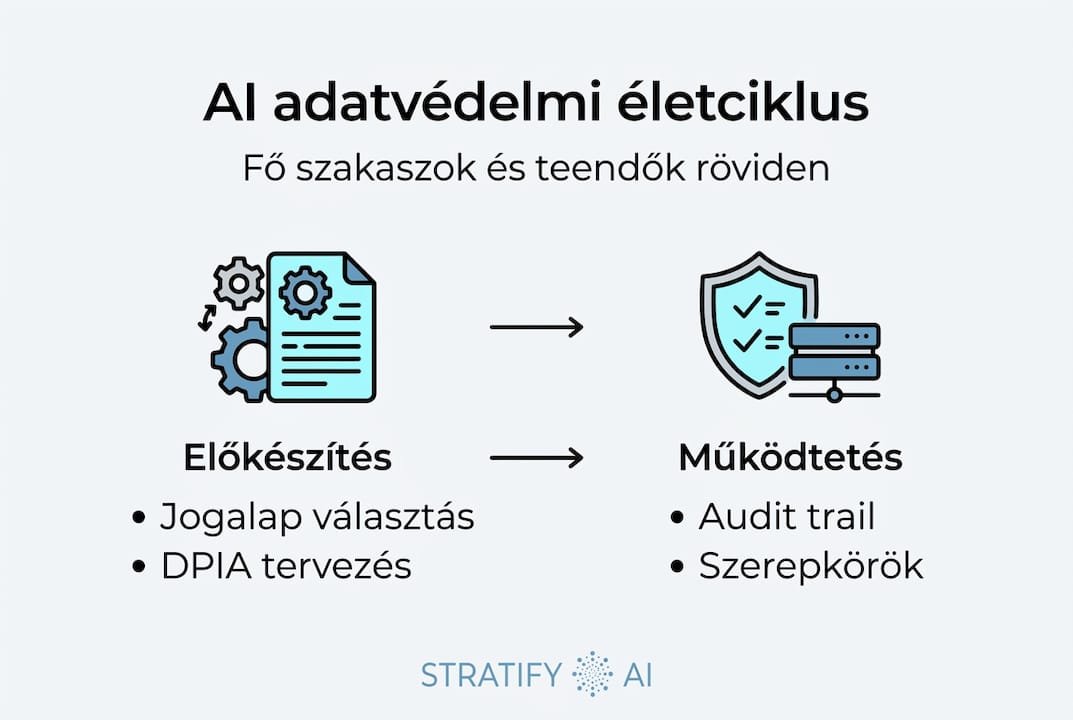

Életciklus-alapú megfelelőség: a tréningtől a bevezetésig

Az azonosíthatóság és a jogalap-megfelelés szakaszonként változik egy AI-rendszer életciklusa során. Ez azt jelenti, hogy amit fejlesztési fázisban megoldottunk, az nem feltétlenül fedezi a deployment fázis elvárásait, és fordítva.

Nézzük meg, hogyan fest ez a különböző szakaszokban:

| Életciklus-szakasz | Fő adatvédelmi kérdések | Legfontosabb dokumentáció |

|---|---|---|

| Adatgyűjtés és előfeldolgozás | Jogalap, forrás hitelessége, hozzájárulás | Nyilvántartás az adatforrásokról |

| Modellbetanítás | Újra-azonosíthatóság kockázata, adatminimalizálás | Betanítási adatok origine, anonimizálási módszer |

| Tesztelés és validálás | Tesztadatok jogszerűsége, bias-értékelés | Tesztelési napló, kockázatértékelés |

| Deployment | Átláthatóság, érintetti tájékoztatás | DPIA, adatkezelési tájékoztató |

| Üzemeltetés és frissítés | Adatdrift, modellfrissítések kockázatai | Audit trail, rendszeres felülvizsgálat |

Különösen kritikus pont a betanítási adatok eredete. Ha egy modell jogellenes forrásból, például hozzájárulás nélkül gyűjtött webes tartalomból, vagy lejárt hozzájárulás alapján kezelt személyes adatokból tanult, ez a jogszerűtlenség áthúzódik a teljes modell életciklusára. Sok vállalat csak a deployment fázisban szembesül azzal, hogy a betanítási adatok audita problémákat vet fel.

- Ellenőrizze minden betanítási adatforrás jogalapját, és dokumentálja az ellenőrzés eredményét.

- Gondoskodjon arról, hogy a hozzájárulások hatálya kiterjedjen az AI-betanítási célokra is.

- Végezzen due diligence vizsgálatot a külső adatszolgáltatóknál és API-forrásoknál.

- Vezessen naprakész nyilvántartást arról, mikor, kitől és milyen jogalapon szerezte az adatokat.

A DPIA (adatvédelmi hatásvizsgálat) az egyik legfontosabb eszköz, amelyet AI-projekteknél alkalmazni kell. Nem csupán jogi kötelezettség, hanem valódi kockázatfeltárási módszer is. Az AI adatbiztonság útmutató részletesen tárgyalja, hogyan kell elvégezni egy AI-specifikus DPIA-t.

Profi tipp: Az audit trail nem csupán egy technikai napló. Ha egy felügyeleti hatóság vizsgálatot indít, az audit trail az egyetlen eszköz, amellyel bizonyíthatja, hogy a folyamatok megfeleltek az előírásoknak. Vezessen részletes, időbélyeggel ellátott nyilvántartást minden adatkezelési döntésről, modellfrissítésről és hozzáférési eseményről.

Az életciklus-szemléletű megfelelőség azt is jelenti, hogy nem elegendő egyszer elvégezni a DPIA-t és utána elfeledkezni róla. Az AI-modell megváltozik, az adatkörnyezet változik, és a szabályozói elvárások is fejlődnek. A rendszeres felülvizsgálat nem adminisztratív teher, hanem a valódi kockázatkezelés alapfeltétele.

Magyarországi DPO és DPIA fókusz: gyakorlati ajánlások

Magyar vállalati kontextusban a hazai felügyeleti hatóság, a NAIH (Nemzeti Adatvédelmi és Információszabadság Hatóság) kiemelt figyelmet fordít a mesterséges intelligencia adatvédelmi vonatkozásaira. A NAIH MI-hez kapcsolódó adatvédelmi tájékoztatót publikált az adatvédelmi tisztviselők számára, amely konkrét szempontokat és esettanulmányokat tartalmaz.

A tájékoztató néhány kulcsterületet emel ki:

- Belső képzések: A DPO-k feladata nemcsak a megfelelőség figyelése, hanem a szervezet munkatársainak folyamatos képzése is. Az AI-rendszerek kapcsán ez különösen fontos, mert az érintett munkavállalók sokszor nincsenek tisztában azzal, hogy adataikat esetleg AI-betanításra is felhasználják.

- Governance folyamatok: A NAIH hangsúlyozza a strukturált döntéshozatali folyamatok fontosságát. Ki dönthet arról, hogy egy AI-rendszer éles környezetbe kerül? Milyen szempontokat kell mérlegelni?

- Érintetti jogok kezelése: Az AI-rendszereknél különösen összetett az érintetti jogok (hozzáférés, törlés, tiltakozás) biztosítása. A NAIH elvárja, hogy a vállalatok ezekre konkrét eljárásrenddel rendelkezzenek.

Az AI oktatás cégeknek megvalósítása ezért stratégiai befektetés, nem csupán kötelező adminisztráció. Ha a szervezet minden szintjén értik az adatvédelmi kockázatokat, sokkal kisebb az esélye a véletlen megfelelőségi hibáknak.

A DPIA-k vonatkozásában a magyarországi vállalatoknál néhány tipikus hiba ismétlődik:

- A DPIA-t utólag készítik el, ahelyett, hogy a projekt tervezési fázisában végeznék.

- A kockázatértékelés túlságosan általános, nem az adott AI-rendszer specifikus kockázataira koncentrál.

- Nem vonják be a DPO-t a korai fázisban, csak akkor, amikor problémák merülnek fel.

Profi tipp: Az AI rendszerek kockázatainak kezelésénél ne tekintse a DPIA-t egy „kipipálandó" feladatnak. Egy jól elvégzett hatásvizsgálat valódi üzleti értéket teremt: feltárja a rejtett kockázatokat, javítja a döntéshozatal minőségét, és dokumentált módon igazolja a gondos adatkezelést a hatóságok felé.

Ami a hatékony AI audit gyakorlatokat illeti, ezek alkalmazása magyar vállalatoknál is egyre inkább elvárás. A NAIH által közzétett útmutatók ezért nem csupán jogi hivatkozásként hasznosak, hanem valódi belső képzési anyagként is felhasználhatók.

Mi az, amit a szakértők gyakran rosszul láttatnak az AI adatvédelem terén?

Az elmúlt évek vállalati AI-projektjei során egy visszatérő mintát látunk: a megfelelőséget adminisztratív teherként kezelik, nem versenyelőnyként. Pedig a valóság az, hogy az a vállalat, amely megbízható, jól dokumentált és átlátható AI-rendszereket üzemeltet, sokkal gyorsabban nyeri el az ügyfelek, partnerek és befektetők bizalmát.

A legveszélyesebb pont nem a DPIA hiánya, hanem a tréningadat-forrás dokumentálatlansága. Ha nem tudja igazolni, hogy honnan és milyen jogalapon gyűjtötte a betanítási adatokat, egy hatósági vizsgálat esetén nincs védekezési alapja. Az AI adatokhoz kapcsolódó versenyelőny pontosan ebből fakad: aki rendben tartja az adatgazdálkodást, az gyorsabban és biztonságosabban fejleszt.

A „tick-box" megfelelőség egy illúzió. A kitöltött DPIA-sablon és az aláírt adatfeldolgozói szerződés önmagában nem véd meg sem bírságtól, sem reputációs kártól, ha a valódi adatfolyamatok nem felelnek meg az elvárásoknak. Az adatvédelmi kultúrát a fejlesztési csapat mindennapos döntéseibe kell beépíteni, nem csak a jogi osztály feladataként kezelni. Ez a szemléletváltás az, ami valódi különbséget jelent.

Lépjen a gyakorlati megfelelőség útjára AI tanácsadó partnertől

Az adatvédelmi megfelelőség az AI-projekteknél olyan terep, ahol az elméleti tudáson túl konkrét tapasztalat és strukturált módszertan szükséges a sikeres megvalósításhoz.

A Stratify csapata pontosan ezért dolgozik ki egyedi, vállalatra szabott megközelítést minden AI-bevezetési projekthez. Az AI és Data Science szolgáltatások keretében segítünk a jogalap-elemzéstől a DPIA elkészítéséig, a szerepkör-dokumentációtól az audit trail kialakításáig. Az AI bevezetési módszertanunk kifejezetten arra épül, hogy a jogi megfelelőség és az üzleti értékteremtés ne egymás ellen dolgozzon, hanem egymást erősítse. Ha komolyan veszi az adatvédelmet, mi komolyan vesszük a partnerséget.

Gyakran ismételt kérdések

Az AI modellek használatában minden adat automatikusan anonimnak számít?

Nem, az anonimitás nem automatikus: minden AI-modellt eseti vizsgálatnak kell alávetni, hogy megfelel-e az anonimitás elvárásainak, mivel a re-identifikáció kockázata szinte mindig fennáll.

Mikor kötelező DPIA-t készíteni AI-projektnél?

Ha a mesterséges intelligencia különösen érzékeny adatokat vagy nagy mennyiségű személyes adatot kezel, DPIA elvégzése kötelező, és ajánlott már a tervezési fázisban elvégezni, nem utólag.

Hogyan segítheti a vállalatokat a NAIH gyakorlati adatvédelmi tájékoztatója?

A NAIH útmutatója konkrét esettanulmányokat és szakmai fókuszokat ad a belső képzésekhez és a governance-folyamatokhoz, amelyek közvetlenül alkalmazhatók a vállalati DPO-k munkájában.

Milyen dokumentációval tud megfelelni egy AI projekt a magyar adatvédelmi elvárásoknak?

A szerepkör-dokumentáció, a tréningadat-eredet igazolása, valamint a DPIA és a részletes audit trail vezetése nélkülözhetetlen a hatósági elvárások teljesítéséhez.