TL;DR:

- A jó minőségű és strukturált dokumentumok alapvetően meghatározzák az AI tudásbázis sikerét.

- A fokozatos, kis lépésekben történő fejlesztés eredményesebb, mint a teljes vállalati adatok azonnali betöltése.

- Az adatvédelmi előírásokat és jogi szempontokat szigorúan figyelembe kell venni a tudásbázis kialakításakor.

Sok vállalatnál az AI tudástár projektje nem a technológián bukik el, hanem azon, amit a rendszer elé tesznek: rossz minőségű, kaotikusan szervezett, feldolgozásra alkalmatlan dokumentumokon. Az eredmény pontosan olyan lesz, amilyen az alap: egy drága, de megbízhatatlan rendszer, amely több kérdést vet fel, mint amennyit megválaszol. Ez a cikk nem általánosságban mutatja be az AI tudástárakat, hanem konkrétan megmondja, milyen dokumentumtípusokat válassz, hogyan készítsd elő őket, és milyen jogi, módszertani szempontokra figyelj, ha valóban működő rendszert akarsz felépíteni.

Tartalomjegyzék

- Miért létfontosságú a megfelelő dokumentumválasztás AI tudástárakhoz?

- Mely dokumentumtípusokból érdemes kiindulni?

- Hogyan készítsük elő a dokumentumokat AI tudástárhoz?

- Adatvédelmi és jogi megfelelés: mire kell ügyelni?

- Kiemelt módszertani tippek: hogyan hozz ki többet a tudástárból?

- Mi a legnagyobb hiba, amit a magyar vállalatok elkövetnek AI tudástár építésekor?

- Vidd tovább a vállalati AI tudástárad fejlesztését – szakértői támogatással

- Gyakori kérdések

Fő Tanulságok

| Pont | Részletek |

|---|---|

| Dokumentumtípus kiválasztás | A tudásbázis hatékonysága alapvetően múlik a forrásdokumentumok típusán és minőségén. |

| Előkészítés fontossága | A megfelelő tisztítás, chunking és formátum jelentősen javítja az AI visszakeresést. |

| Adatvédelmi megfelelés | GDPR és AI Act figyelembevétele kritikus a jogi és üzleti kockázatok csökkentésére. |

| Szakmai módszertan | Semantikus chunking, hybrid search és reranking kombinációja nagyban fokozza a vállalati tudástár értékét. |

Miért létfontosságú a megfelelő dokumentumválasztás AI tudástárakhoz?

Egy AI tudástár pontosan annyit ér, amennyit a belé táplált adatok. Ez nem elméleti kijelentés, hanem az egyik leggyakrabban visszaigazolt gyakorlati tapasztalat. Ha a forrásanyag hiányos, ellentmondásos vagy nehezen értelmezhető, az AI modell is bizonytalan, téves válaszokat fog adni.

Az AI tudásbázis üzleti értéke alapvetően azon múlik, mennyire gondosan választod ki a forrásokat. A vállalatok nagy többsége azonban azonnal a teljes iratarchívum feltöltésébe kezd, holott ez a legkockázatosabb megközelítés. Egy strukturálatlan, vegyes minőségű dokumentumhalmazból az AI sem tud koherens tudást felépíteni.

Mik a leggyakoribb hibák dokumentumválasztásnál?

- Túl sok, túl vegyes forrás egyszerre: Százféle dokumentumtípusból, különböző korú és minőségű anyagokból összeszedett halmaz.

- Elavult tartalmak bevonása: Régi szabályzatok, visszavont eljárásrendek, amelyek az aktuális folyamatoktól eltérnek.

- Strukturálatlan szövegek előnyben részesítése: Kézzel írt jegyzetek, szkennelt, OCR-es hibáktól teli PDF-ek.

- Jogi és adatvédelmi kockázat figyelmen kívül hagyása: Személyes adatokat tartalmazó dokumentumok szűrés nélkül a rendszerbe kerülnek.

“A típikus induló dokumentumvolumen 100-1000 dokumentum között mozog; a CRM rekordok, ERP adatok, email archívumok és meeting jegyzőkönyvek bevonása magas komplexitásuk miatt csak óvatosan javasolt.”

Ez azt jelenti, hogy nem a mennyiség, hanem a minőség és a struktúra számít. Egy jól kiválasztott 200 dokumentumból álló pilot sokkal tanulságosabb és értékesebb, mint egy 10 000 darabos, kaotikus importálás.

Mely dokumentumtípusokból érdemes kiindulni?

Miután tisztáztuk a dokumentumválasztás fontosságát, vizsgáljuk meg konkrétan, mely típusokat érdemes gyűjteni és miért.

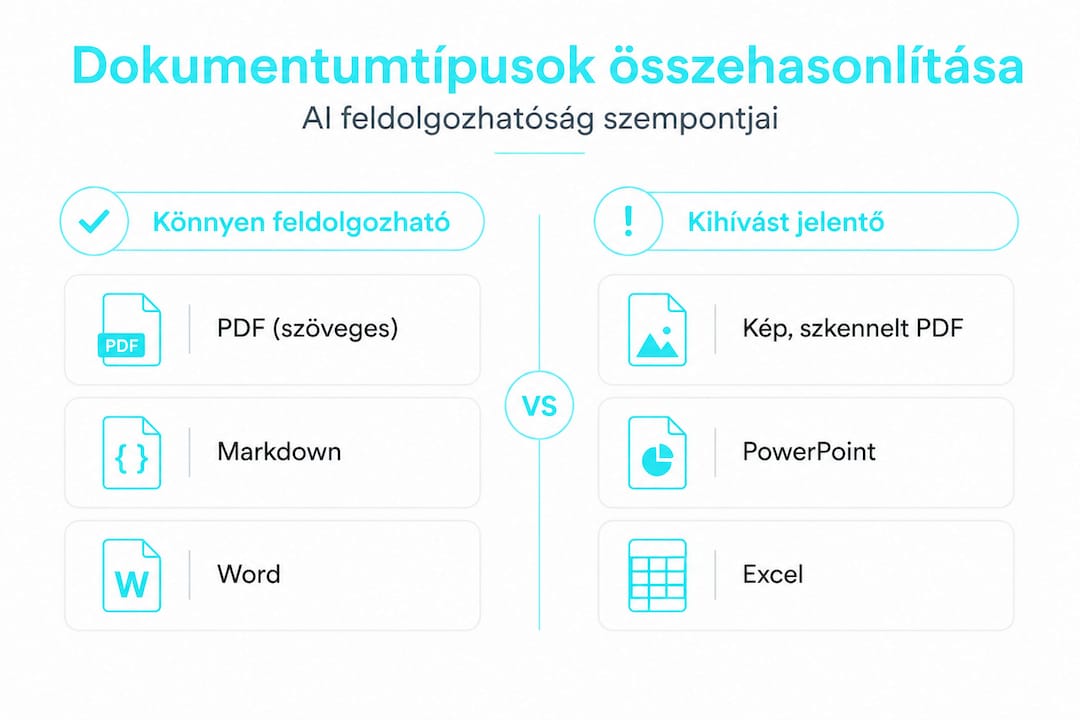

A vállalati dokumentumok nem egyformán alkalmasak AI feldolgozásra. Egyesek szinte “maguktól” beilleszthetők, mások komoly előkészítési munkát igényelnek. Az alábbi táblázat segít eligazodni:

| Dokumentumtípus | Feldolgozhatóság | Tipikus tartalom | Ajánlott? |

|---|---|---|---|

| PDF (szöveges) | Magas | Szabályzatok, útmutatók | Igen |

| DOCX | Magas | Belső folyamatok, leírások | Igen |

| XLSX | Közepes | Adattáblák, kimutatások | Igen, struktúráltan |

| PPTX | Közepes | Prezentációk, összefoglalók | Feltételesen |

| HTML | Magas | Belső wiki, intranet | Igen |

| Email archívum | Alacsony | Levelezés, egyeztetések | Óvatosan |

| CRM/ERP export | Alacsony | Ügyfél- és tranzakcióadatok | Óvatosan |

A dokumentumfeldolgozás automatizálása szempontjából a legjobb kiindulópontok az egységes, szöveges PDF-ek, a Word dokumentumok és a HTML alapú belső oldalak. Ezeket már ma feldolgozhatod Docling eszközökkel, amelyek a PDF, DOCX, XLSX, PPTX és HTML fájlokat automatikusan Markdown formátumra konvertálják, ami a RAG (Retrieval-Augmented Generation) rendszerek számára ideális.

Mit kerülj el ebben a fázisban?

- Kézi konverzió nagy mennyiségnél: Ha 500 dokumentumot manuálisan alakítasz át, az hosszú órák hibás munkája lesz. Automatizált pipeline-ra van szükséged.

- Szkennelt, képalapú PDF-ek OCR nélkül: Ezekből az AI nem tud olvasható szöveget kinyerni.

- Különböző verziójú, duplikált fájlok: Ugyanannak a szabályzatnak öt különböző verziója zavaros, ellentmondó válaszokat eredményez.

Az AI alapú értékesítési és ajánlatadási rendszerek esetében például a termékleírások, árlisták és szerződéssablonok a leghasznosabb forrástípusok, mivel ezek strukturáltak, rendszeresen frissülnek, és egyértelmű kérdés-válasz viszonyokat hoznak létre a tudástárban.

Profi tipp: Mielőtt elkezdened a nagy dokumentumimportot, végezz egy egyhetes “adatminőség-auditot”: válassz ki 20-30 reprezentatív dokumentumot, és nézd meg, milyen arányban tartalmaznak hibát, duplikációt vagy elavult adatot. Ez megmutatja, mekkora előkészítési munkára kell számítani.

Hogyan készítsük elő a dokumentumokat AI tudástárhoz?

Megvannak a források, most lépjünk tovább az előkészítés rejtelmeire: részletezzük a szükséges lépéseket.

A dokumentum-előkészítés az a fázis, ahol a legtöbb vállalat elveszíti a türelmét és “átugrik” a következő lépésre. Ez súlyos hiba. Az AWS legjobb gyakorlatai alapján a dokumentumok előkészítésekor három kulcslépésre kell fókuszálni: tisztítás, szegmentálás (chunking), és formátumkonverzió.

Az ajánlott folyamat lépésről lépésre:

-

Tisztítás: Távolítsd el az ismétlődő fejléceket, lábléceket, oldalszámokat, vízjeleket és a tartalomhoz nem tartozó elemeket. Ezek zajt visznek a rendszerbe, és rontják a visszakeresési pontosságot.

-

Duplikáció-szűrés: Azonosítsd és szűrd ki az azonos vagy erősen hasonló tartalmú dokumentumokat. Egy szabályzat négy verziója közül tartsd meg az aktuálisat.

-

Chunking (szegmentálás): A hosszú dokumentumokat 300-500 tokenes egységekre kell bontani. A tokene kb. 0,75 szónak felel meg, tehát egy chunk nagyjából 225-375 szavas szövegrész. Fontos, hogy a chunkoknak legyen némi átfedésük (10-15%) a szomszéd egységekkel, hogy a kontextus ne törjön meg.

-

Szemantikus szegmentálás: Ne mechanikusan, szószám alapján vágj, hanem témák, bekezdések és logikai egységek szerint. Az AI erőforrás-optimalizálás szempontjából ez az egyik legjobb befektetés, amit a projekt elején megtehetsz.

-

Markdown konverzió: A végleges dokumentumokat Markdown formátumra alakítsd. Ez a formátum az AI rendszerek számára optimálisan olvasható, a fejezetek, listák, táblázatok struktúrája megmarad, és a feldolgozás gyorsabb lesz.

-

Metaadatok hozzáadása: Minden dokumentumhoz rögzítsd a készítés dátumát, a felelős szervezeti egységet, az érvényességi időszakot és a hozzáférési szintet. Ezek nélkül a keresési jogosultságok kezelése lehetetlen lesz.

Profi tipp: Indítsd el a folyamatot egy 100-200 dokumentumos pilottal. Ez elegendő ahhoz, hogy megtapasztald a feldolgozás gyengepontjait, finomítsd a chunking-stratégiát, és megalapozd a skálázást anélkül, hogy visszafordíthatatlan hibákat követnél el nagy mennyiségnél.

Adatvédelmi és jogi megfelelés: mire kell ügyelni?

Az előkészítési lépések után áttérünk egy kulcsterületre: az adatvédelemre és jogi megfelelésre.

A GDPR és az EU AI Act nem opcionális keretrendszerek, hanem kötelező érvényű szabályok, amelyek megsértése komoly bírságokat von maga után. Magyar vállalatok számára ez különösen fontos, hiszen az AI Act kötelezettségei már most befolyásolják, hogyan kezelheted a munkavállalói, ügyféladatokat és a belső dokumentumokban megjelenő személyes információkat.

Mire kell különösen figyelni?

- Személyes adatok kiszűrése: Bármely dokumentum, amely munkavállalók, ügyfelek vagy partnerek személyes adatait tartalmazza, csak anonymizálva kerülhet az AI tudástárba.

- Hozzáférési jogosultságok dokumentumonként: Nem minden munkavállaló láthat minden dokumentumot. A tudástárnak tükröznie kell a cégen belüli jogosultsági szinteket.

- Adatfeldolgozási szerződések (DPA): Ha külső felhőszolgáltatót használsz az AI futtatásához, kötelező adatfeldolgozói megállapodást kötni.

- On-premise vs. felhő döntés: Különösen érzékeny szektorokban (egészségügy, pénzügy, jog) a helyi LLM futtatása vagy on-premise telepítés az egyetlen biztonságos megoldás.

Kiemelés: Az AI és adatvédelem területén egyre több vizsgálat zajlik a vállalatok adatkezelési gyakorlatával kapcsolatban. A megelőzés lényegesen olcsóbb, mint a szankciók kezelése.

A jogi kockázat csökkentésének legjobb módja: mielőtt bármilyen dokumentumot feltöltesz az AI rendszerbe, konzultálj adatvédelmi jogásszal, és kötelező érvényű belső szabályzatot dolgozz ki az AI számára engedélyezett adatkategóriákra vonatkozóan. Ez nem bürokratikus formalitás, hanem az egész projekt fenntarthatóságának alapja.

Kiemelt módszertani tippek: hogyan hozz ki többet a tudástárból?

Miután lefedtük a jogi és technikai alapokat, érdemes rátérni a szakmai fogásokra, amelyekkel valóban kiemelkedő lesz a tudástár.

A leggyakoribb tévhit az, hogy ha egyszer feltöltötted a dokumentumokat, a rendszer “magától működik.” A valóság más. A visszakeresési minőség folyamatos finomítást igényel, és a módszertan megválasztása döntően befolyásolja az eredményt.

Az alábbi összehasonlítás mutatja, mit érnek a különböző megközelítések a gyakorlatban:

| Módszer | Hatása a pontosságra | Komplexitás | Ajánlott fázis |

|---|---|---|---|

| Fixed-size chunking | Alapszint | Alacsony | Prototípus |

| Szemantikus chunking | 40-60%-kal jobb retrieval | Közepes | Éles rendszer |

| Hybrid search | Szignifikánsan jobb | Közepes | Éles rendszer |

| Reranking | 15-30%-kal jobb precision | Magas | Skálázott rendszer |

A szemantikus chunking lényege: nem mechanikusan szabod szét a szöveget, hanem a gondolati egységek mentén. Ez azt jelenti, hogy egy bekezdés, amely egyetlen fogalmat magyaráz, egészben marad, nem kerül szét két különböző chunk-ba. Ennek eredménye, hogy az AI kontextuálisan helyes válaszokat tud adni.

A hybrid search kombinálja a hagyományos kulcsszóalapú keresést (BM25) és a szemantikus vektoros keresést. Önmagában mindkettő gyengébb, együtt viszont egymás vakfoltjait kompenzálják.

A reranking egy második szűrési réteg: az első keresési eredmények közül egy külön modell rangsorolja újra a találatokat, amelyek valóban relevánsak a kérdéshez. Ez különösen hosszú, összetett dokumentumok esetén ad drámai javulást.

Profi tipp: Ne vezess be egyszerre minden fejlett módszert. Kezdj a szemantikus chunkinggal, mérd az eredményt, majd add hozzá a hybrid search-öt. Minden változtatás után tesztelj legalább 50 kérdéssel, és rögzítsd az eredményeket. Az AI alkalmazások kereskedelmi környezetben is azt mutatják, hogy az iteratív fejlesztés 3-4-szer annyi tanulságot hoz, mint az egyszeri, komplex bevezetés.

Mi a legnagyobb hiba, amit a magyar vállalatok elkövetnek AI tudástár építésekor?

Évek alatt sok vállalat AI tudástár-projektjét láttuk közelről, és a leggyakoribb kudarc meglepően egyszerű okra vezethető vissza. Nem a technológia volt rossz. Nem a csapat volt alkalmatlan. A hiba az volt, hogy a projekt az első naptól teljes volumennel indult.

A logika érthető: ha már belefektetsz egy AI rendszerbe, természetesen az egész céges tudásanyagot szeretnéd beletenni. A pénzügyi osztály összes szerződése, az összes HR-dokumentum, az utóbbi tíz év összes sales prezentációja, az email archívum 2015-ig visszamenőleg. Ez papíron vonzó, a valóságban azonban az AI tudásmenedzsment legsúlyosabb csapdája.

Miért? Mert egy ilyen gigászi, heterogén adathalmaz feldolgozása hónapokat vesz igénybe. A minőség-ellenőrzés reménytelen. A jogi kockázat kezelhetetlenné válik. A csapat kiég az első hónapban. Az AI rendszer teli van zajjal, és a végeredmény egy drága, rosszul működő chatbot, amelyet senki nem használ.

A mi ajánlásunk ezzel szemben: pilot-first gondolkodás. Válassz ki egyetlen jól körülírt területet, ahol a fájdalom a legnagyobb. Gyűjts össze 100-200 jó minőségű dokumentumot. Dolgozd fel őket gondosan. Tesztelj, mérj, tanulj. Utána bővítsd a kört.

Ez nem gyávaság, hanem stratégia. Azok a vállalatok, amelyek kis lépésekben, de dokumentáltan haladnak, általában 6-8 hónapon belül éles, valóban értéket termelő rendszert tudnak üzemeltetni. Azok, akik mindennel egyszerre kezdenek, sok esetben másfél év után is a “fejlesztési fázisban” vannak.

Az a paradoxon, hogy a kevesebből való indulás gyorsabb eredményt hoz. Ez a tapasztalat alapján nem vita tárgya, hanem megfigyelt tény.

Vidd tovább a vállalati AI tudástárad fejlesztését – szakértői támogatással

Az itt leírt szempontok és lépések akkor hoznak valódi eredményt, ha az egész folyamatot strukturáltan, megfelelő módszertannal és tapasztalt partnerrel valósítod meg. A dokumentumkiválasztástól az adatvédelmi megfelelésen át a technikai architektúráig számos döntési pont van, ahol egy elcsúszott választás hónapnyi munkát tesz semmissé.

A stratify.hu csapata AI tanácsadási szolgáltatásokkal és személyre szabott AI bevezetési workshopokkal segíti a magyar vállalatokat abban, hogy ne a próbálgatás-hibázás útján, hanem bizonyított módszertannal, gyorsabban és kevesebb kockázattal jussanak el a működő tudástárig. Ha az alapoktól a skálázásig teljes machine learning tanácsadást szeretnél, vedd fel velünk a kapcsolatot, és nézzük meg együtt, hol áll most a projekted.

Gyakori kérdések

Mennyi dokumentummal érdemes indítani egy AI tudástár építését?

Általában 100-1000 dokumentum elegendő a pilot fázis elkezdéséhez: ez a mennyiség lehetővé teszi az érdemi tapasztalatgyűjtést anélkül, hogy az előkészítési munka kezelhetetlenné válna, ahogy azt az EnterpriseRAG-Bench is megerősíti.

Miért előnyös a Markdown formátum a dokumentum-előkészítésben?

A Markdown strukturált, könnyen feldolgozható formátum, amely növeli az AI visszakeresési pontosságát és jól illeszkedik a chunking folyamatokba, így az AWS legjobb RAG-gyakorlataiban is ez az ajánlott kimeneti formátum.

Kell-e tartanom adatvédelmi megfelelési kockázattól AI-s tudásbázis esetén?

Igen, minden vállalatnak figyelembe kell vennie a GDPR és AI Act előírásait, és különösen érzékeny adatok esetén helyi LLM vagy on-premise megoldás alkalmazása javasolt.

Mi az a szemantikus chunking, és miért jobb a fixed-size szegmentációnál?

A szemantikus chunking tartalom és logikai egységek szerinti szövegdarabolás, amely a RAG benchmark adatok szerint 40-60%-kal jobb visszakeresési pontosságot ad a merev méretű szegmentációhoz képest, mivel megőrzi a gondolati összefüggéseket.